HarmonyOS鸿蒙Next对Ollama的支持

HarmonyOS鸿蒙Next对Ollama的支持 https://developer.huawei.com/consumer/cn/blog/topic/03175975712912026

各位老师,现在api21环境,支持ollama的部署与模型切换吗

开发者您好,请您提供以下信息,方便问题分析解决:

- 您打算部署的设备类型(比如手机);

- 您是个人开发者还是企业开发者。

更多关于HarmonyOS鸿蒙Next对Ollama的支持的实战系列教程也可以访问 https://www.itying.com/category-93-b0.html

企业开发者

现在的测试机是nova 14 pro

BQ3588(瑞芯微的),后续可能有其他平台

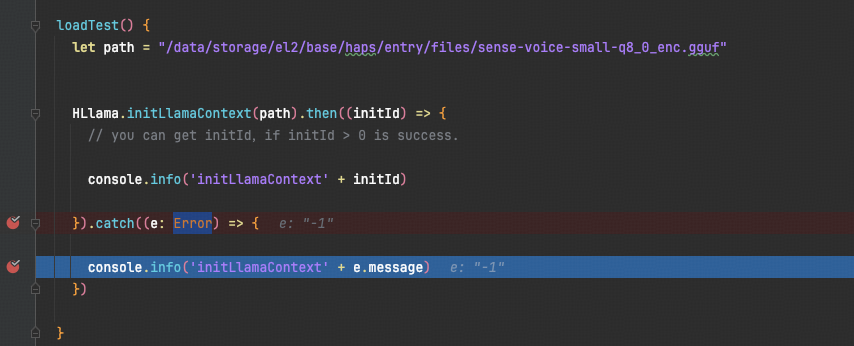

llama 混编+NDK的方式可以加载但是有问题,还在调,

老师你好,这边是做model在端侧,集成使用的,

现在是自家gguf跑通了NDK的方式,

但是跑HLLama加载不了

找HarmonyOS工作还需要会Flutter的哦,有需要Flutter教程的可以学学大地老师的教程,很不错,B站免费学的哦:https://www.bilibili.com/video/BV1S4411E7LY/?p=17

开发者您好,目前是需要集成到端使用还是希望通过HarmonyOS来进行训练?如果是集成到端侧直接使用,可以通过CANN Kit来进行部署,具体还要看您使用到了哪些算子,和具体机型芯片的兼容性如何?如果是希望使用HarmonyOS来进行训练麻烦告知下具体的业务场景。

HarmonyOS Next目前未官方支持Ollama。Ollama主要面向主流桌面操作系统(如Windows、macOS、Linux)提供原生支持。在鸿蒙Next上运行Ollama,需等待其官方适配或通过兼容性技术(如容器)实现,但这并非标准支持方案。

目前,HarmonyOS NEXT(API 21)作为面向全场景的分布式操作系统,其核心设计聚焦于原生智能与高性能。对于Ollama这类基于本地运行的大型语言模型框架,HarmonyOS NEXT在技术架构上具备支持潜力,主要体现在:

-

系统兼容性:HarmonyOS NEXT使用ArkTS/ArkUI开发,其底层为纯Harmony内核,不支持直接运行Linux动态库(.so文件)。若需部署Ollama,需通过以下方式适配:

- 重编译移植:将Ollama的C++核心代码及依赖库(如libtorch)针对Harmony内核进行交叉编译。

- 容器化方案:利用系统支持的轻量级容器(如基于Kubernetes的元服务架构)封装Ollama的Linux环境。

-

硬件加速支持:若设备搭载NPU(如麒麟9000S),可通过HarmonyOS AI框架(MindSpore等)对接模型推理,实现端侧高性能计算。但需将Ollama的模型转换为适配格式(如ONNX)。

-

模型切换机制:若完成底层适配,模型管理可通过以下路径实现:

- 利用HarmonyOS数据管理接口,动态加载不同模型文件。

- 通过元服务架构实现多模型实例的隔离与热切换。

当前华为官方未提供Ollama的预置集成方案,开发者需自主完成移植工作。建议关注HarmonyOS NEXT的AI套件更新,后续可能提供更便捷的本地大模型部署工具链。