Python中请教scrapy爬虫中间件的一个问题

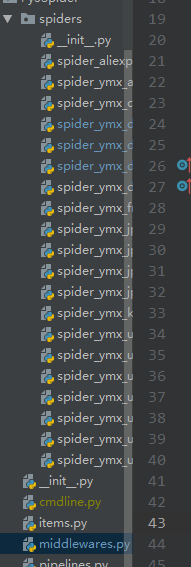

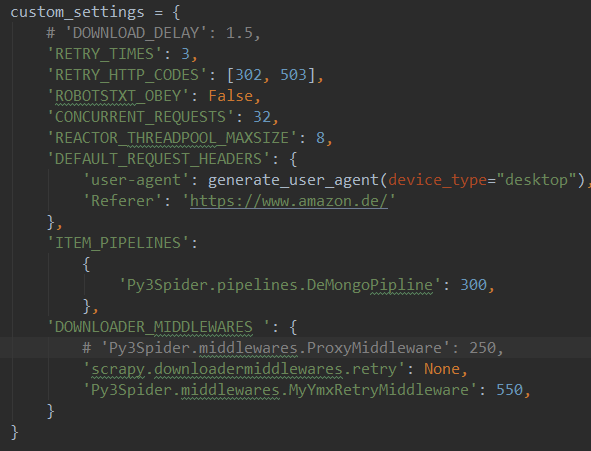

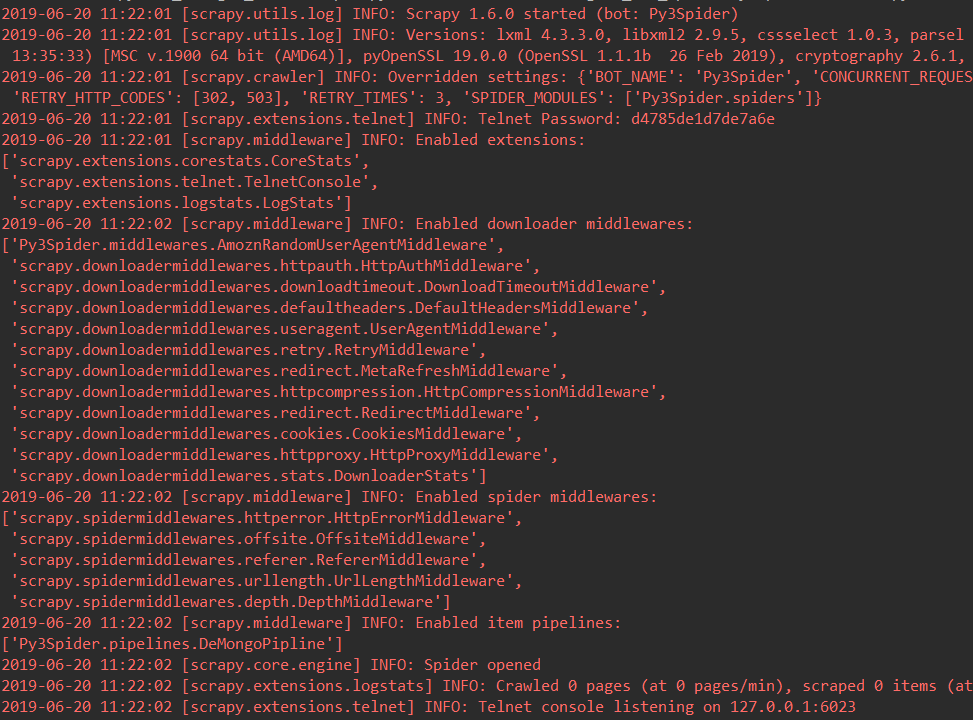

一个工程下有很多 spider 类(图一),每个类有独立的 custom_settings (图 2 ),我自定义的重试中间件没有生效(图 3 ),其他的公共的随机头,单独的 item 管道生效了。请问自定义重试中间件如何配置呢. scrapy.downloadermiddlewares.retry.RetryMiddleware 写成这样似乎也没开启

Python中请教scrapy爬虫中间件的一个问题

4 回复

550 好像大于框架自带的 retry middleware,你可以手动关闭框架自带的 retry middleware 试试

这么多爬虫,不如试一下 crawlab 的可配置爬虫

https: / /github.com /tikazyq/crawlab

记得有些是需要关闭自带的不知道你这个有没有

感谢各位的回复,在 custom_settings 中配置自定义重试总是不生效,最后在 setting 文件中生效了